Hadoop 海量數據存儲與計算的革命性解決方案

在當今大數據時代,企業和組織面臨著前所未有的數據挑戰。傳統的數據處理系統已經難以應對PB級別的海量數據,而Hadoop作為開源分布式系統的杰出代表,為海量數據的存儲和計算提供了革命性的解決方案。

Hadoop的核心架構與組件

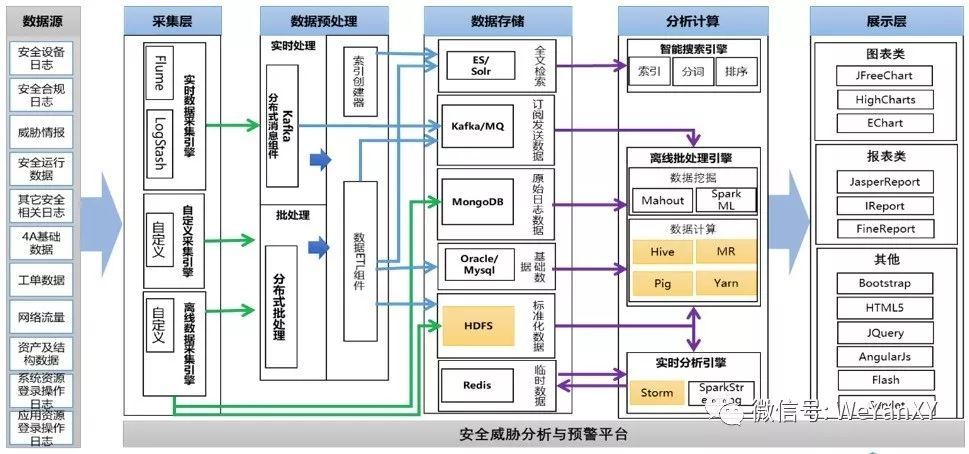

Hadoop生態系統主要由兩大核心組件構成:HDFS(Hadoop分布式文件系統)和MapReduce計算框架。

HDFS:可靠的數據存儲基石

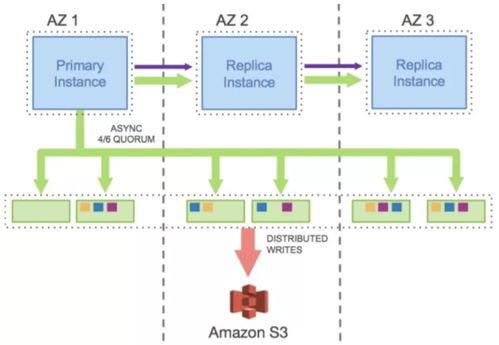

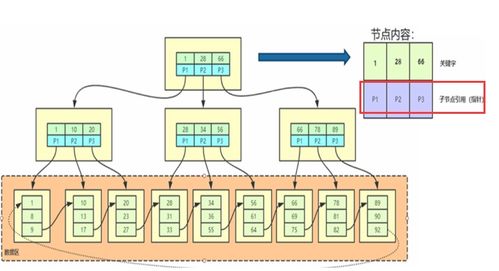

HDFS采用主從架構設計,由NameNode和DataNode組成。NameNode負責管理文件系統的元數據,而DataNode則存儲實際的數據塊。這種設計具有以下顯著優勢:

- 高容錯性:數據自動復制到多個節點,單點故障不會導致數據丟失

- 高吞吐量:支持大規模數據集的并行讀寫操作

- 可擴展性:能夠輕松擴展到數千個節點,存儲EB級別的數據

- 成本效益:可在廉價的商用硬件上運行

MapReduce:高效的數據處理引擎

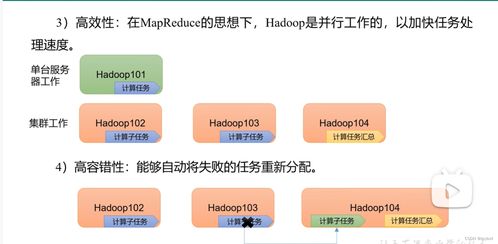

MapReduce采用"分而治之"的策略,將復雜的數據處理任務分解為兩個階段:

Map階段:將輸入數據分割成獨立的塊,由不同的節點并行處理

Reduce階段:將Map階段的輸出進行匯總,生成最終結果

這種計算模型特別適合批處理任務,能夠高效處理TB甚至PB級別的數據。

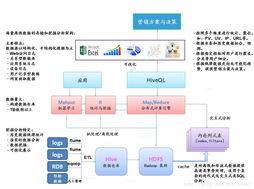

Hadoop的生態系統擴展

除了核心組件,Hadoop還擁有豐富的生態系統:

- HBase:分布式列式數據庫,支持實時數據訪問

- Hive:數據倉庫工具,提供類SQL查詢功能

- Pig:高級數據流語言,簡化MapReduce編程

- Spark:內存計算框架,大幅提升處理速度

- ZooKeeper:分布式協調服務

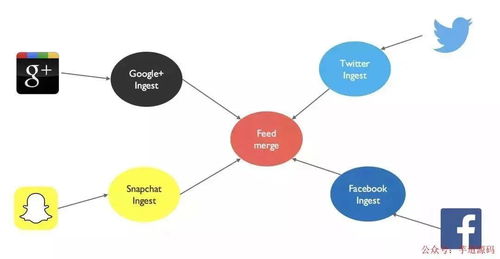

Hadoop在行業中的應用

互聯網行業

各大互聯網公司使用Hadoop進行用戶行為分析、推薦系統構建、日志處理等。例如,Facebook使用Hadoop集群存儲超過100PB的數據,每天處理數PB的用戶數據。

金融行業

銀行和金融機構利用Hadoop進行風險控制、欺詐檢測、客戶畫像分析,能夠實時處理海量的交易數據。

電信行業

電信運營商使用Hadoop分析用戶通話記錄、網絡流量數據,優化網絡資源配置,提升服務質量。

Hadoop的技術優勢

- 線性擴展能力:通過增加節點即可線性提升存儲和計算能力

- 容錯機制:自動處理節點故障,確保系統持續運行

- 數據本地化:計算任務盡可能在數據存儲節點執行,減少網絡傳輸

- 開源生態:活躍的社區支持和豐富的第三方工具

挑戰與發展趨勢

盡管Hadoop在大數據處理方面表現出色,但也面臨一些挑戰:

- 實時處理能力相對較弱

- 運維復雜度較高

- 對技能要求較高

Hadoop正朝著實時化、云原生、智能化方向發展,與容器技術、機器學習等新興技術深度融合。

結語

Hadoop作為大數據技術的基石,已經證明了自己在處理海量數據方面的卓越能力。隨著技術的不斷演進,Hadoop必將在數字經濟時代繼續發揮關鍵作用,為各行各業的數據驅動決策提供強有力的支撐。對于任何需要處理大規模數據的企業來說,掌握和運用Hadoop技術已經成為必備的核心競爭力。

如若轉載,請注明出處:http://www.cmj.org.cn/product/27.html

更新時間:2026-02-24 23:54:24